Die unsachgemäße Nutzung von ChatGPT kann zu Datenschutzproblemen führen, denen Unternehmen aktiv begegnen müssen.

Wenn sie dies nicht tun, besteht die Gefahr, dass Mitarbeiter ChatGPT eigenständig verwenden und dadurch möglicherweise Datenschutzvorschriften verletzen. In solchen Fällen würden die Arbeitgeber haftbar gemacht werden.

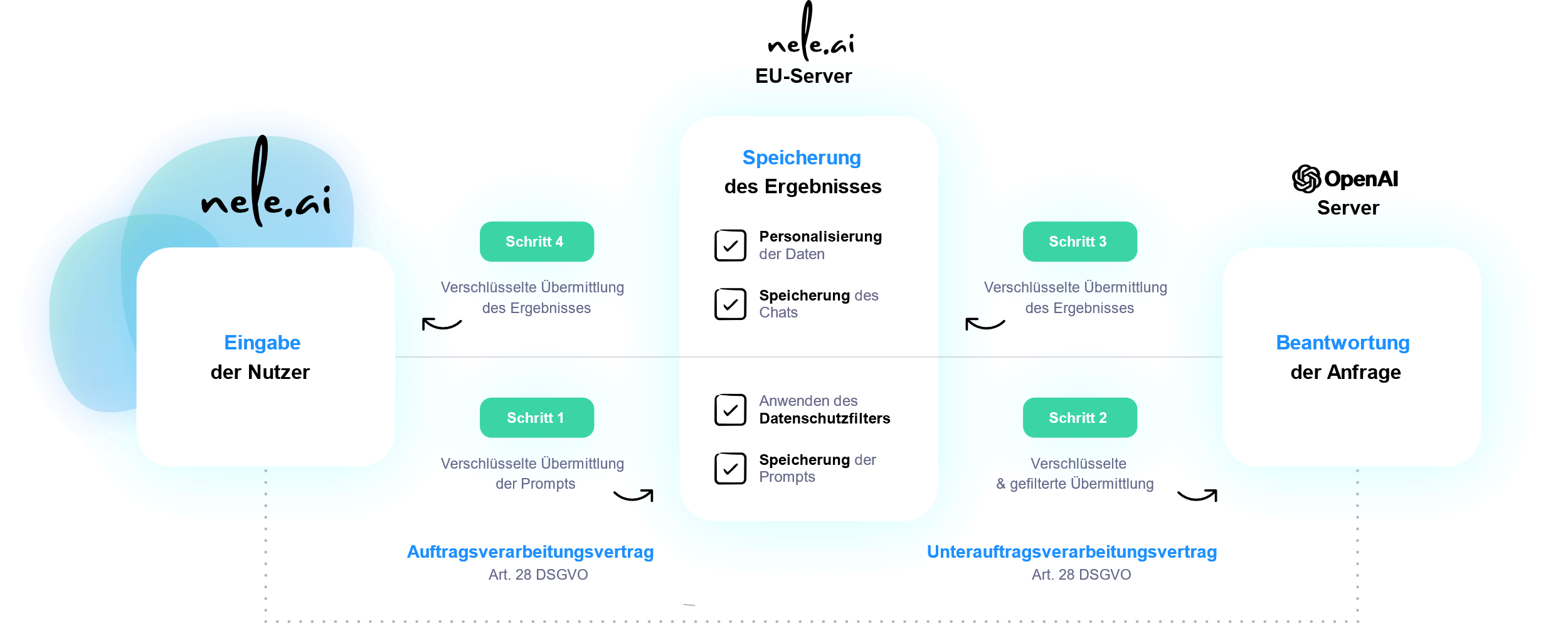

Aus diesem Grund betone ich stets die Bedeutung von Datenschutz-Filtern. Umso erfreulicher ist es für mich, dass meine Mandantin mit nele.ai ein Tool zur Nutzung von KI in Unternehmen entwickelt hat, das einen solchen Datenschutz-Filter enthält.

Dabei werden die Prompts der Mitarbeiter anonymisiert, werden auf einem EU-Server gespeichert (und können dazu auch anderen Mitarbeitern bereitgestellt werden).

Wie das funktioniert beschreibe ich bei LinkedIn und erläutere generell, wie Sie den Datenschutz bei der Verwendung von ChatGPT optimieren können:

nele.ai – Lösung für datenschutzkonforme Nutzung von ChatGPT

P.S. Obwohl ich als Rechtsberater in dieser Angelegenheit natürlich ein bisschen parteiisch bin, freut es mich, endlich auf ein spezifisches Datenschutz-Tool für Chat-GPT hinweisen zu können.